Agentes de IA estão evoluindo rapidamente de demonstrações impressionantes para ferramentas reais que podem agir em seu lugar, e o OpenClaw é um dos nomes que puxaram a última onda de atenção. Você pode ter visto o mesmo software chamado de Clawdbot ou Moltbot, nomes usados em diferentes fases de desenvolvimento pelo criador, o desenvolvedor austríaco Peter Steinberger.

Vendidos como assistentes pessoais “mãos-livres” capazes de operar programas por você, eles também levantam questões importantes sobre acesso e segurança.

- Agentes de IA são sistemas de IA capazes de agir, não apenas ferramentas conversacionais.

- Ferramentas como o OpenClaw mostram o poder dos agentes de IA auto-hospedados.

- Esse poder traz novos riscos de segurança quando agentes processam conteúdo não confiável.

- Injeção de prompt é uma ameaça central para agentes de IA, ainda mais do que para chatbots.

- Memória persistente pode amplificar erros e prolongar ataques.

- Agentes de IA são poderosos, mas não são a escolha mais segura para a maioria dos consumidores por padrão.

Por que tanto burburinho em torno do OpenClaw?

O OpenClaw chama atenção porque representa a mudança de IA que responde perguntas para IA que conseguem executar tarefas reais em um sistema e até controlar software. As potenciais questões de segurança também fizeram com que mais gente falasse sobre o OpenClaw em círculos de segurança. O que torna o OpenClaw atraente para desenvolvedores e usuários avançados?

O diferencial do OpenClaw é que ele pode tomar ações concretas, não apenas gerar texto ou sugestões. Em vez de dizer a você o que fazer, ele pode executar tarefas por conta própria. A tecnologia consegue abrir aplicativos, enviar mensagens, mover arquivos, rodar comandos e interagir diretamente com sistemas em seu nome.

Esse nível de automação é o que desperta interesse. Desenvolvedores e usuários avançados veem o controle a nível de sistema como uma forma de reduzir trabalhos repetitivos ou automatizar fluxos de trabalho. A ideia de um agente de IA que pode “fazer o trabalho” em vez de apenas ajudar é atraente.

Essa promessa de capacidade prática é por que o OpenClaw saiu rapidamente de um projeto de nicho para uma discussão mais ampla.

Por que isso importa além do OpenClaw?

O OpenClaw é um exemplo visível de uma mudança maior em direção a agentes de IA que de fato agem, em vez de apenas responder e aconselhar.

Questões sobre uso indevido tornam-se inevitáveis à medida que esse tipo de tecnologia cresce. O que o OpenClaw demonstra é para onde os agentes de IA estão indo. Isso torna o tema relevante muito além de um único projeto e prepara o terreno para debates contínuos sobre como esses agentes devem ser controlados. Dá para confiar neles?

O que são agentes de IA e o que os diferencia de outras ferramentas de IA?

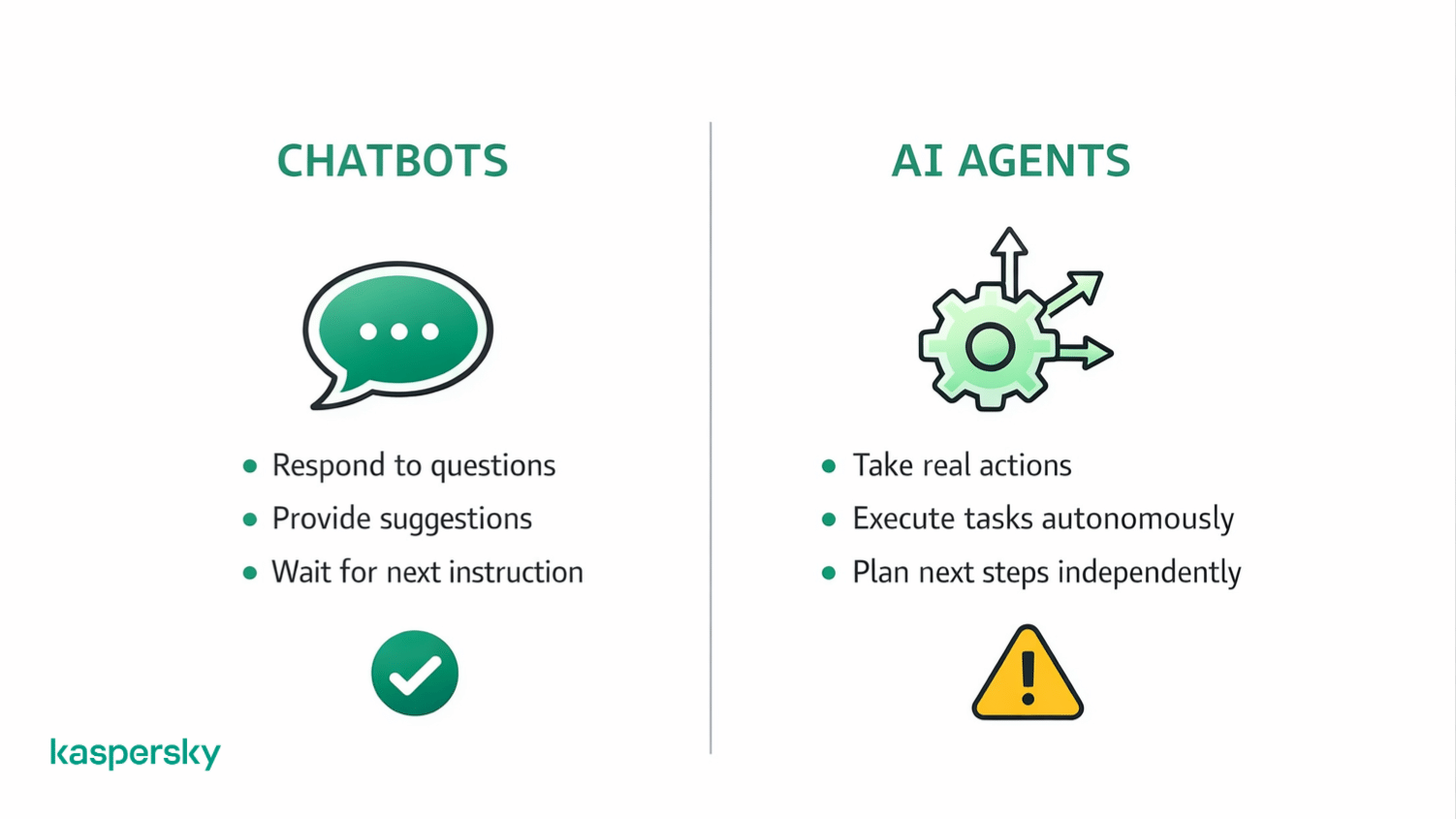

Agentes de IA são sistemas que não se limitam a fornecer respostas em texto ou áudio para suas perguntas. Eles podem planejar passos e executar ações para atingir um objetivo. Em vez de parar no conselho, eles decidem o que fazer a seguir e executam.

Um agente de IA pode observar uma situação e agir. Isso difere da maioria das ferramentas de IA, que respondem a prompts, mas aguardam a próxima instrução. Exemplos iniciais incluem agentes de execução de tarefas como o Manus (agora propriedade da Meta). O Manus mostra como agentes podem ir além do chat e passar para a ação. Ele pode fornecer análise de dados ou até escrever código ativamente para resolver problemas sem precisar ser explicitamente instruído sobre cada passo. Há menos intervenção humana.

O OpenClaw segue essa mesma ideia de IA capaz de agir, mas a aplica de forma mais direta e potente.

O OpenClaw é um agente de IA típico ou algo mais avançado?

O OpenClaw se encaixa na categoria de agentes de IA. Oferece uma implementação mais poderosa do que muitas das ferramentas com que a maioria das pessoas já está familiarizada.

Essa ferramenta de IA consegue planejar tarefas e agir sem entrada constante. O OpenClaw consegue interagir diretamente com software e com o sistema operacional, não apenas com APIs ou ferramentas limitadas. Esse acesso mais amplo aumenta a utilidade e o diferencia. Também eleva a aposta e a importância da segurança.

Por que agentes de IA auto-hospedados são diferentes

Agentes de IA auto-hospedados rodam localmente no seu próprio sistema em vez de em um serviço remoto. Isso dá aos usuários mais controle sobre configuração e comportamento. Também desloca responsabilidades.

Quando um agente tem acesso local, a segurança depende de como ele foi configurado, quais permissões recebeu e como é monitorado. Mais controle traz mais risco.

Projetos recentes mostram que a ideia de agentes de IA “auto-hospedados” está mudando. Por exemplo, o Moltbot (anteriormente Clawdbot) agora pode ser executado usando o Moltworker, da Cloudflare, um projeto de código aberto. Isso elimina totalmente a necessidade de hardware local dedicado ao rodar o agente em uma plataforma gerenciada.

Isso reduz a barreira de entrada e simplifica a configuração, mas também altera onde o controle fica. Quando um agente roda em infraestrutura na nuvem, a segurança passa a depender não só do próprio agente, mas de controles de acesso e de como dados e permissões são gerenciados na plataforma.

Por exemplo, um usuário pode conectar um agente de IA ao seu e-mail esperando que ele apenas leia mensagens, enquanto a configuração na nuvem também permite enviar e-mails a menos que essa permissão seja explicitamente desativada.

Como agentes de IA diferem de chatbots como o ChatGPT?

Chatbots como o ChatGPT respondem; agentes de IA agem.

Um chatbot pode oferecer sugestões ou explicações. Um agente de IA pode abrir programas ou executar fluxos de trabalho ativamente.

Como exemplo, algumas pessoas usaram o OpenClaw para automatizar negociações no mercado. Elas definiram regras e pediram ao sistema de IA não apenas para aconselhar (algo que o ChatGPT poderia fazer), mas para realmente executar as operações.

Por que agentes de IA introduzem novos riscos de segurança?

Como discutido acima, agentes de IA tomam ações em vez de apenas fornecer conselhos. Isso frequentemente implica acesso a arquivos, aplicativos ou funções do sistema.

O acesso ao sistema e a autonomia concedidos ao OpenClaw alteram tanto o impacto quanto o risco. O OpenClaw pode solicitar permissão para interagir com software ou realizar ações como enviar um e-mail ou preencher formulários sem supervisão. Isso o transforma em uma variável imprevisível.

Erros ou manipulações podem ter consequências reais. O risco não é só o que o agente foi instruído a fazer, mas o que ele interpreta como instrução enquanto executa uma tarefa.

Por que entrada não confiável é um problema central

Agentes de IA consomem grandes quantidades de conteúdo externo (como páginas web e documentos) para decidir o que fazer a seguir. Esse conteúdo nem sempre é confiável.

Instruções não precisam ser diretas. Podem estar escondidas em textos ou dados que o agente lê durante uma tarefa. Isso permite que atacantes influenciem o comportamento do agente sem nunca interagir diretamente com ele.

Esse problema abre um caminho claro para a injeção de prompt. É quando entrada não confiável é usada para direcionar o agente a executar ações que ele nunca deveria realizar.

Ferramentas de IA poderosas exigem proteção mais robusta

Agentes de IA podem acessar arquivos, e-mails e funções do sistema. O Kaspersky Premium ajuda a detectar atividades suspeitas, bloquear scripts maliciosos e proteger seus dispositivos contra ameaças cibernéticas reais.

Experimente o Premium grátisO que é injeção de prompt em agentes de IA?

Injeção de prompt é uma forma de manipular um agente de IA fornecendo conteúdo não confiável que altera seu comportamento.

O risco não é um defeito técnico no código. O problema é que o agente pode tratar entradas externas — como mensagens ou comentários — como instruções. Quando isso acontece, o agente pode ser guiado a executar ações para as quais nunca foi projetado.

Como a injeção de prompt funciona em cenários do mundo real

Injeção de prompt pode ser direta ou indireta.

- Direta – um atacante inclui deliberadamente instruções no conteúdo que o agente lê.

- Indireta – o agente captura instruções ocultas ou inesperadas de um site ou mensagem que processa durante tarefas normais.

A questão central é o comportamento. O agente pode seguir o que interpreta como orientação, mesmo que essa orientação venha de fontes não confiáveis. Não é preciso haver um bug de software para que isso ocorra.

Por que a injeção de prompt é mais perigosa para agentes de IA do que para chatbots?

Instruções injetadas normalmente afetam respostas e conselhos dados por chatbots. Com agentes de IA, elas podem afetar ações.

Se um agente tem acesso a arquivos ou controles do sistema, instruções manipuladas podem levar a mudanças no mundo real. É por isso que a injeção de prompt representa um risco maior para agentes: a mesma técnica que altera a saída de texto de um chatbot pode desencadear ações indesejadas quando um agente está envolvido.

O que é memória persistente em agentes de IA?

Memória persistente permite que um agente de IA retenha informações ao longo do tempo. Isso significa que ele pode usar entradas anteriores para guiar decisões futuras, em vez de começar do zero a cada tarefa.

O que memória persistente significa para agentes de IA?

Um agente de IA pode armazenar contexto e instruções entre sessões, além de desenvolver “comportamentos” preferidos. Isso ajuda o agente a trabalhar de forma mais eficiente ao lembrar o que aprendeu ou fez antes.

Também significa que entradas anteriores podem influenciar comportamentos futuros. Instruções ou pressuposições absorvidas em uma tarefa anterior podem continuar a moldar como o agente age em outra situação, mesmo que o usuário já não saiba disso.

Por que memória persistente aumenta os riscos de segurança?

Memória persistente pode introduzir efeitos retardados. Uma instrução nociva pode não causar problemas imediatos, mas reaparecer mais tarde quando as condições se alinharem.

Isso torna a limpeza mais difícil. O comportamento armazenado pode se repetir entre tarefas. Restaurar completamente um agente frequentemente exige limpar a memória ou reconstruir configurações para garantir que influências indesejadas sejam removidas.

O que acontece quando um agente de IA é mal configurado ou exposto?

Um agente de IA pode ser acessado ou influenciado de maneiras que o proprietário nunca imaginou, transformando uma ferramenta útil em um risco de segurança.

Isso pode ocorrer por acidente ou por mal-entendido. Também pode acontecer se terceiros tentarem manipular o agente.

Como agentes de IA podem ficar expostos sem querer?

A exposição costuma ocorrer por erros simples. Algo tão básico quanto autenticação fraca ou permissões excessivamente amplas pode tornar um agente acessível fora do ambiente pretendido.

Executar um agente localmente não garante automaticamente segurança. Se ele se conecta à internet ou interage com outros sistemas, pode ser influenciado. O controle local reduz alguns riscos.

Por que agentes de IA expostos viram superfícies de ataque?

Uma vez exposto, um agente de IA torna-se algo que atacantes podem sondar, testar e manipular. Eles podem tentar alimentar entradas criadas sob medida, acionar ações ou aprender como ele se comporta ao longo do tempo.

Como agentes podem executar ações reais, o abuso não precisa parecer um ataque tradicional. O mau uso pode envolver direcionar comportamentos, extrair dados ou causar alterações indesejadas no sistema, tudo isso sem explorar uma falha clássica de software.

O que é a “tríade letal” na segurança de agentes de IA?

A “tríade letal” descreve três condições que juntas criam um risco de segurança sério para agentes de IA.

As três condições que viabilizam ataques sérios

- A primeira condição é acesso a dados sensíveis, como arquivos, credenciais ou informações internas.

- A segunda é entrada não confiável, ou seja, o agente consome conteúdo que não pode verificar totalmente.

- A terceira é a habilidade de realizar ações externas, como enviar requisições, modificar sistemas ou executar comandos.

Individualmente, esses fatores podem ser gerenciáveis. Tornam-se perigosos quando formam essa tríade. Um agente que lê entrada não confiável e pode agir sobre ela cria um caminho claro para manipulação. Controlar quais ações um agente tem permissão para executar é vital.

Usuários comuns devem executar agentes de IA hoje?

Para a maioria das pessoas, agentes de IA ainda são ferramentas experimentais. Podem ser úteis em configurações adequadas. A desvantagem? Também introduzem novos riscos que nem sempre são óbvios.

Quando faz sentido usar um agente de IA?

Um agente de IA pode fazer sentido em cenários controlados e de baixo risco. Isso inclui experimentos em um dispositivo separado. Algumas pessoas executam agentes que lidam apenas com tarefas não sensíveis, como organizar arquivos ou testar fluxos de trabalho.

Por exemplo, se você quiser que o agente monte um roteiro de viagem, ele pode acessar as informações necessárias para isso e ser impedido de contatar pessoas diretamente ou realizar ações potencialmente danosas.

Se você se sente confortável gerenciando configurações e os erros não forem de alto impacto, um agente pode ser uma ferramenta de aprendizagem. A chave é manter o escopo pequeno e limitar estritamente o acesso.

Quando agentes de IA são uma má ideia?

Agentes de IA não são recomendáveis quando têm acesso a dados sensíveis ou contas importantes. Executar agentes sem entender permissões ou os perigos de entradas externas aumenta o risco rapidamente.

Também é perfeitamente razoável optar por não usar um agente. Decidir não executar um agente de IA hoje é uma escolha sensata se a conveniência custar segurança ou tranquilidade.

Quais salvaguardas básicas são essenciais ao usar agentes de IA?

Medidas básicas reduzem riscos e evitam que erros se tornem problemas graves.

O software da Kaspersky pode adicionar uma camada extra de proteção ao sinalizar comportamentos suspeitos e ajudar a proteger contas contra invasões. Nossos planos bloqueiam desde malware e vírus até ransomware e apps espiões.

Quais medidas de segurança importam mais?

Isolamento é fundamental. Execute agentes em dispositivos e contas separados sempre que possível, para que não afetem dados ou sistemas importantes. Limite permissões ao mínimo que o agente realmente precise. Recomendamos evitar dar acesso total ao sistema ou a contas por padrão.

Passos de aprovação também são importantes. Exigir confirmação antes de ações sensíveis cria uma pausa que pode evitar comportamentos não intencionais, como autorizar gastos em seu nome. Esses controles simples têm grande impacto sem acrescentar muita complexidade.

O que os agentes de IA significam para o futuro da IA de consumo?

Agentes de IA apontam para um futuro em que ferramentas de IA fazem mais do que ajudar: elas agem. Mas essa mudança vem com trade-offs que os consumidores estão começando a entender.

O que esse momento nos diz sobre a maturidade dos agentes de IA?

Agentes de IA são poderosos, porém imaturos. Conseguem automatizar tarefas, mas ainda enfrentam dificuldades em alguns aspectos de julgamento e segurança. Isso não significa que os agentes não se tornarão mais seguros ou confiáveis; significa que as expectativas devem ser realistas.

Agentes de IA mostram para onde as coisas caminham, mas o uso amplo e diário exigirá salvaguardas melhores e ferramentas concebidas com segurança desde o início.

Artigos relacionados:

- Como o ChatGPT trata preocupações de cibersegurança e riscos potenciais?

- Quais são os riscos do cibercrime com IA no cenário digital atual?

- Como IA e aprendizado de máquina reforçam medidas de cibersegurança?

- Quais são os perigos da tecnologia Deepfake hoje?

Produtos recomendados:

FAQs

O OpenClaw é gratuito para baixar?

O OpenClaw pode ser baixado gratuitamente no GitHub. É um software de código aberto. Isso significa que outras pessoas têm liberdade para modificar e redistribuir o programa.

O OpenClaw é fácil de configurar?

Existem tutoriais que ajudam a colocar bots em funcionamento rapidamente, mas uma configuração sofisticada exige tempo e conhecimento especializado. Isso torna mais arriscado executar um software que pode não ter sido configurado corretamente.